В этом году Нобелевскую премию по физике присудили учёным, разработавшим методы, которые легли в основу современного машинного обучения. Американец Джон Хопфилд и канадец Джеффри Хинтон проводили работу с искусственными нейронными сетями с 1980-х годов. Работы вызвали новую волну интереса год назад, когда Хинтон ушёл из компании Google, чтобы свободно говорить об опасностях и рисках, связанных с развитием искусственного интеллекта. Хопфилд же спустя несколько часов после того, как его объявили лауреатом Нобелевской премии, заявил, что присоединяется к своему коллеге, и предупредил о возможности контроля нейросетей над человеком.

В России вопрос того, как дальше будет развиваться искусственный интеллект, также стоит на повестке дня. Об этом говорили на прошедшем Форуме этики в сфере искусственного интеллекта. В российском научном сообществе решение Нобелевского комитета расценили как ещё одно подтверждение значимости развития нейросетей – и неизбежных этических вопросов, встающих за этим развитием.

– Премию получили безусловно два достойнейших человека, но сами работы не имеют отношения к физике, – отметил директор по развитию технологий искусственного интеллекта ООО «Яндекс» Александр Крайнов на форуме. – Их наградили за достижения, которые были сделаны в 1980-х годах, и это говорит о том, что искусственный интеллект значит так много, что мимо этих изобретений просто не могли пройти. Появление искусственного интеллекта похоже на появление персональных компьютеров, интернета или открытие электричества. Это так называемые сквозные технологии, которые открывают очень большие возможности, благодаря которым очень многое меняется в жизни. Давайте будем честными: когда появились персональные компьютеры, люди использовали их, чтобы играть в игрушки и печатать. И только потом пришли к тому, что это инструмент каждодневного использования, который улучшает нашу эффективность. С искусственным интеллектом то же самое. Сейчас искусственный интеллект – по большому счёту как игрушка или такая «печатная машинка». Но уже есть и его серьёзные применения, в том числе в медицине. Потихоньку это будет дополняться,

Королевская Шведская академия наук приняла решение присудить Нобелевскую премию по физике 2024 года 91-летнему Джону Хопфилду и 76-летнему Джеффри Хинтону. В 1980-х исследователи, вдохновившись работой мозга, изобрели технологии, которые могут хранить и извлекать воспоминания и самостоятельно обучаться на основе поступающей в них информации. Они фактически стали «родителями» современных нейросетей. Хопфилд создал нейронную сеть, которая хранила изображения и другую информацию в виде шаблонов – как мозг хранит тысячи воспоминаний. Сеть могла «вспоминать» изображения, когда ей подсказывали похожие шаблоны, – как человек, способный напеть мелодию, услышанную однажды. Хинтон развил исследования Хопфилда, дав возможность нейросети включать в поиск «вероятности», – иными словами, он «научил» нейросеть распознавать, классифицировать и даже генерировать изображения после загрузки обучающего набора изображений. Так учёные, в сущности, разработали технологии, благодаря которым появились системы распознавания лиц и генеративного искусственного интеллекта, используемые сейчас в чат-ботах типа ChatGPT.

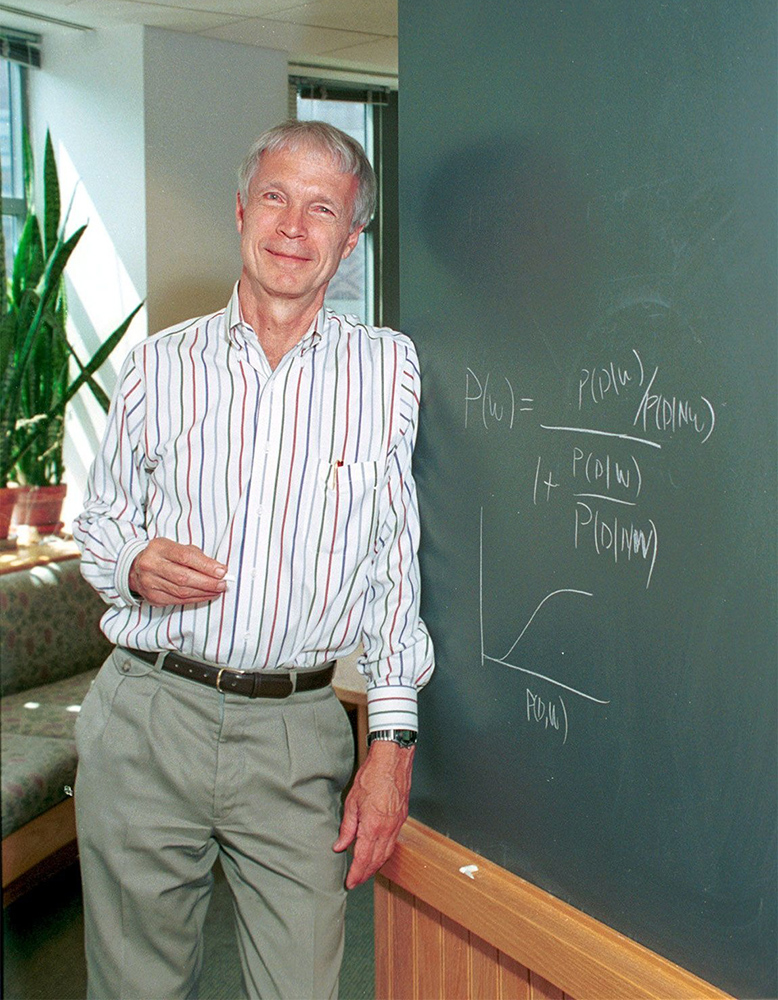

Джон Хопфилд. Фото: Denise Applewhite / Princeton University

Джон Хопфилд. Фото: Denise Applewhite / Princeton UniversityЗа «фундаментальные открытия и изобретения, которые позволяют осуществлять машинное обучение с использованием искусственных нейронных сетей», Хинтон и Хопфилд получили премию в 11 миллионов шведских крон (около 810 тысяч фунтов стерлингов). В Нобелевском комитете по физике отметили, что работы принесли огромную пользу, а искусственные нейронные сети уже активно применяют в разных областях – например, при разработке новых материалов с определёнными свойствами. Сам Хинтон не раз отмечал, что технологии замечательно показали себя «во многих отношениях». Но на этот раз, выступая на пресс-конференции Нобелевской премии, Хинтон призвал беспокоиться о последствиях.

– Нам следует беспокоиться о ряде возможных плохих последствий. В частности, об угрозе выхода этих вещей из-под контроля. У нас нет опыта, каково это, когда что-то умнее нас, – цитирует учёного агентство Reuters.

В мае прошлого года Джеффри Хинтон попал под пристальное внимание после ухода из компании Google. Он отметил, что компания «действовала очень ответственно» и у него нет причин критиковать своего бывшего работодателя. Однако затем признался, что сожалеет о своем вкладе в область развития искусственного интеллекта и ушел, чтобы иметь возможность более свободно обсуждать опасности технологии, которую сам же и разработал.

В интервью New York Times Хинтон выразил опасения, что чат-боты на основе искусственного интеллекта могут легко использовать злоумышленники. Например, искусственный интеллект позволит политикам и авторитарным лидерам манипулировать своим электоратом и очень быстро влиять на огромное количество людей.

По мнению Хинтона, технологии смогут вытеснить рабочих и стать причиной массовой безработицы, поскольку быстрее усваивают новые модели поведения. Искусственный интеллект в конечном итоге легко заменит распространённые профессии юриста, администратора, ассистента, переводчика, диспетчера, продавца, аналитика, водителя и многие другие.

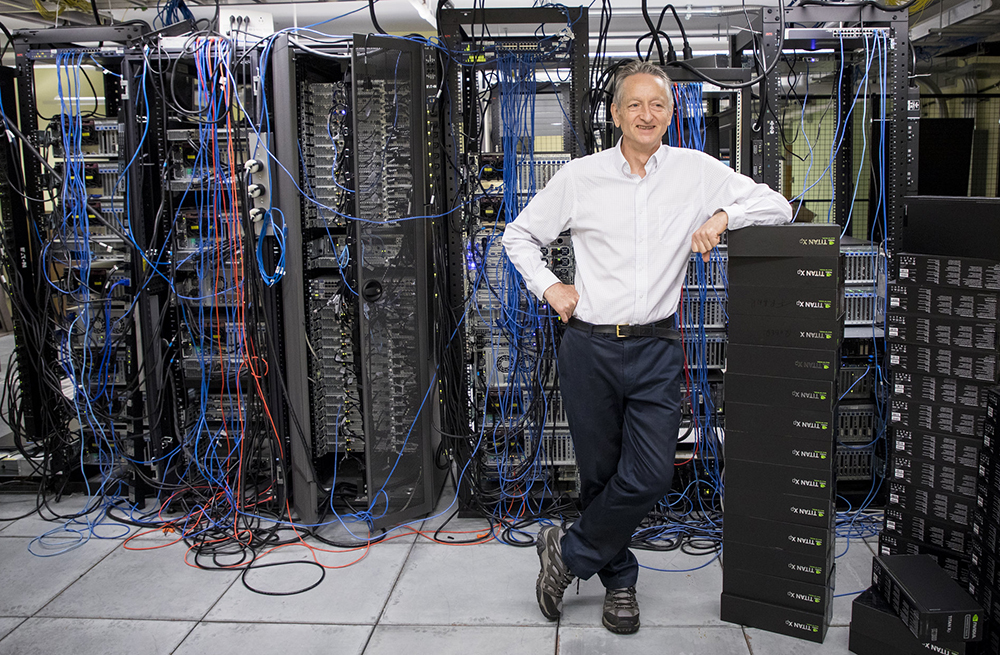

Джеффри Хинтон. Фото: Johnny Guatto / University of Toronto / Flickr

Джеффри Хинтон. Фото: Johnny Guatto / University of Toronto / Flickr– Я пришёл к выводу, что тот тип интеллекта, который мы развиваем, сильно отличается от того, который у нас есть. Как если бы у вас было 10 000 человек, и когда один человек чему-то научился, все автоматически это узнали, – вот как эти чат-боты могут знать гораздо больше, чем любой другой человек, – объяснял учёный.

Машины учатся. И учатся быстро. Компьютеры могут стать умнее людей гораздо раньше, чем ожидают эксперты. Способность искусственного интеллекта создавать убедительные ложные изображения и тексты приведёт к миру, в котором люди «больше не смогут узнать, что является правдой».

– Идея о том, что эта штука действительно может стать умнее людей, – в это верили немногие. В любом случае большинство людей считало, что это очень далеко. И я считал, что это очень далеко. Я думал, что это произойдёт через 30–50 лет или даже дольше. Очевидно, я больше так не думаю, – признался Хинтон.

Присоединился к коллеге и Джон Хопфилд, призвав более глубоко изучить работу систем машинного обучения, чтобы не допустить их выхода из-под контроля.

– Мы привыкли к технологиям, которые не являются исключительно хорошими или исключительно плохими, а обладают возможностями в обоих направлениях. И как физик я очень нервничаю из-за чего-то, что не поддаётся контролю, чего-то, что я не понимаю достаточно хорошо, чтобы понять, каковы пределы, до которых можно было бы довести эту технологию. Вот почему я сам и, я думаю, Джеффри Хинтон тоже настоятельно рекомендуем понять, как будут развиваться некоторые способности, выходящие за рамки тех, которые вы можете себе представить в настоящее время, – заявил Хопфилд, выступая на собрании в Университете Нью-Джерси по видеосвязи, передаёт France24.

Возможности, которые даёт искусственный интеллект и современные системы на его основе, действительно кажутся чудесными, но пока у учёных до конца нет понимания того, как эти системы функционируют. Большинство из них это «очень-очень нервирует».