Впервые учёные из Стэнфордского университета при помощи искусственного интеллекта создали вирусы, нацеленные на уничтожение кишечной палочки E. coli. Для этого использовались две версии алгоритма искусственного интеллекта под названием Evo. Он работает по принципу уже всем известного ChatGPT. Только вместо текстов Evo должен был проанализировать геномы миллионов бактериофагов – так называются вирусы, которые убивают бактерии. Варианты геномов, выбранные нейросетью, учёные преобразовали в цепочки ДНК и интегрировали их в бактерии в чашке Петри. Из 300 сгенерированных ИИ вирусов десяток оказался эффективным. Эксперимент признали успешным, когда белки начали самособираться в вирус и этот вирус стал уничтожать бактерии.

Кто такие бактериофаги?

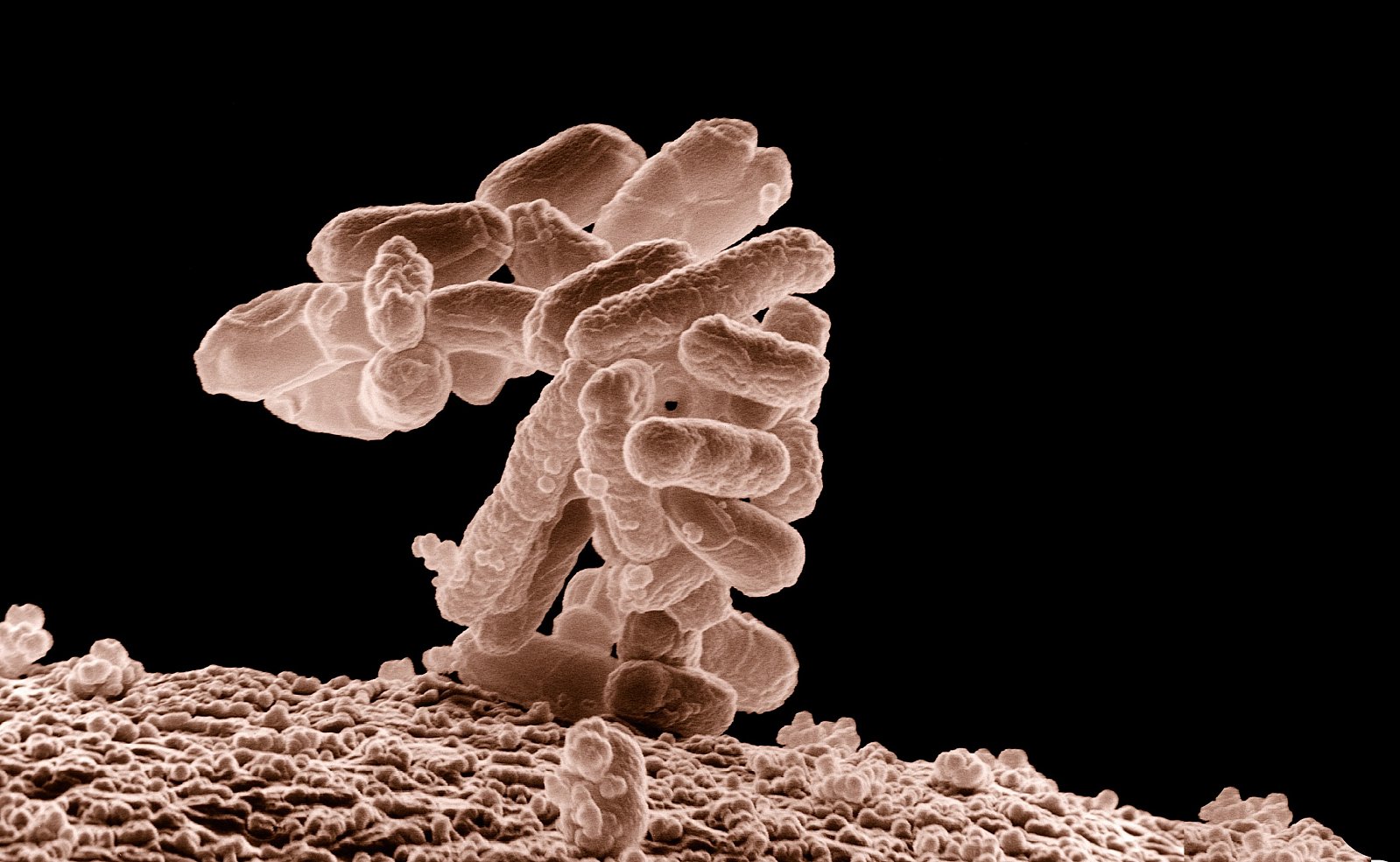

Свой эволюционный путь вирусы и бактерии проходят вместе, являясь друг для друга то антагонистами, то мутуалистами. В одних случаях фаговые вирусы ищут различные способы закрепиться на бактериях, чтобы создать как можно больше своих копий. Бактерии, в свою очередь, ищут способы защититься от них. В других фаги внедряют свои гены в хромосомы бактерий, таким образом защищая микроорганизмы не только от других вирусов, но и от антибиотиков, и обеспечивая устойчивость к ним.

Вообще, о фагах стало известно ещё в начале ХХ века, но через несколько лет после их открытия началось массовое производство антибиотиков, и о бактериофагах не то что забыли, но в целом их несколько игнорировали.

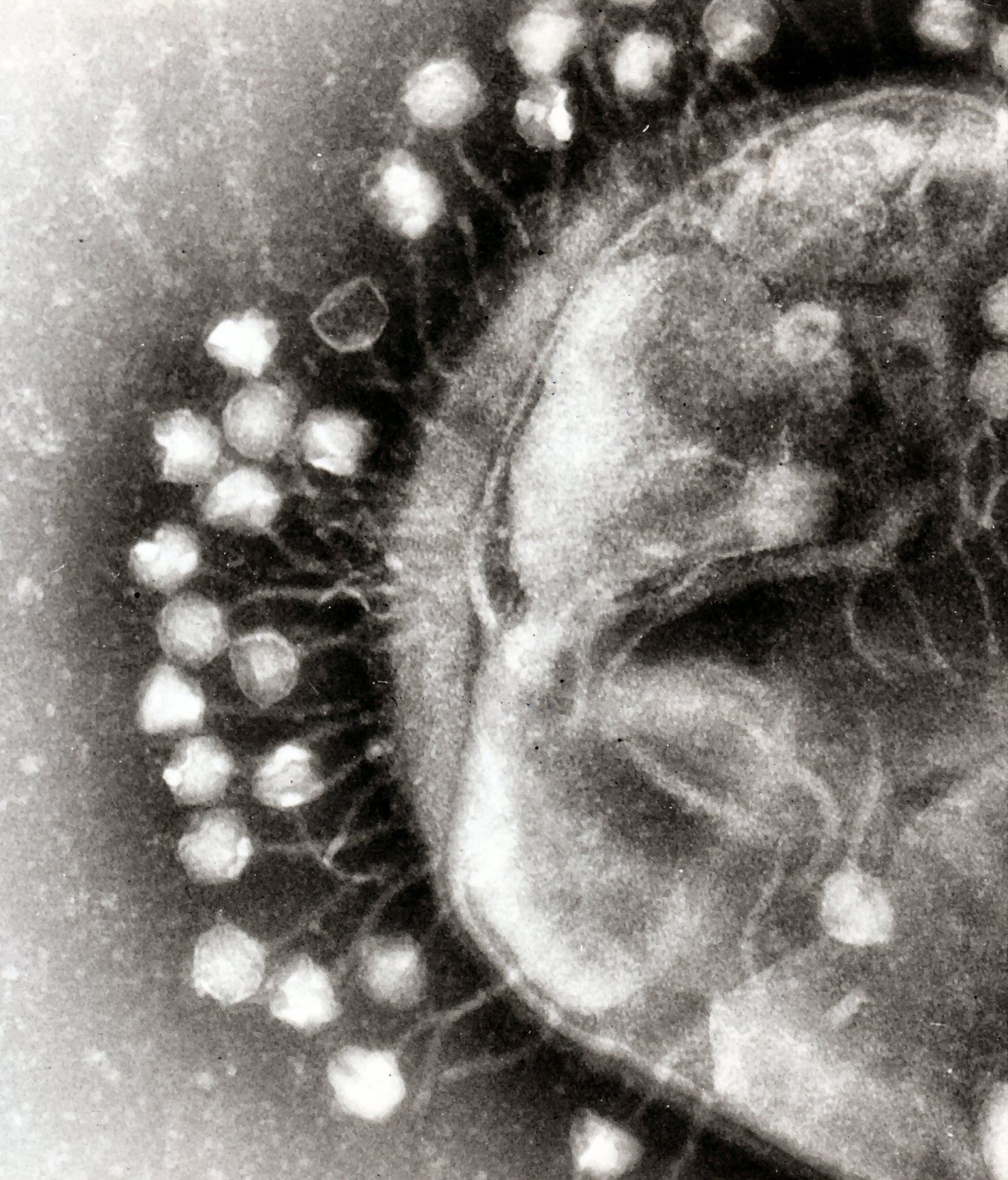

Множественные бактериофаги, прикрепленные к клеточной стенке бактерии. Фото: Professor Graham Beards

Множественные бактериофаги, прикрепленные к клеточной стенке бактерии. Фото: Professor Graham Beards